コラム

【ELPASO会員コラム34-3】生成AIによって人の思考力を低下させないために:批判的思考力の育成

2024年4月26日

事務局

2024.4.26

京都大学 楠見 孝

人工知能(AI)との対話によって文章を作り出すことができる生成 AI (ChatGPT、Being Copilotなど)は、2023年頃から、急速に普及し、ビジネス、日常生活、そして、教育の現場で活用され始めています。

こうした状況を踏まえて、文部科学省は2023年7月に「初等中等教育段階における生成AIの利用に関する暫定的なガイドライン」を作成し、このガイドラインに基づいてパイロット的活用が一部の小中高校で始まっています。

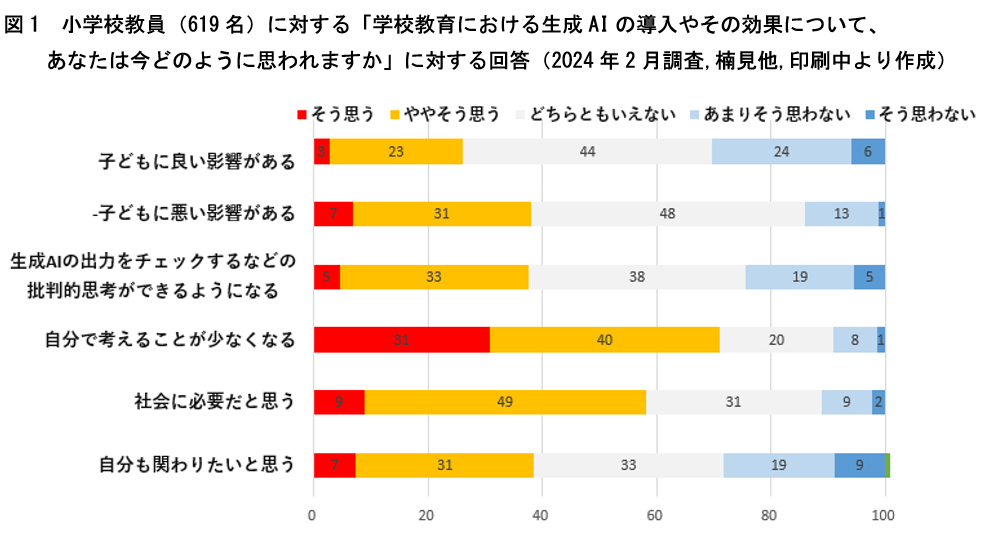

こうした状況を踏まえて、私たちの研究グループ(楠見・齊藤・西川・栗山,印刷中)は、2024年2月に調査会社のモニターである全国の小学校教員619名を対象に、生成AIの教育活用について、web調査を行いました。その結果、授業で生成AIを使ったことのある教員は、全体の13%、日常生活で使ったことがある教員は20%で、まだ少数派でした。さらに、図1に示す「学校教育における生成AIの導入やその効果について、あなたは今どのように思われますか」という質問における「そう思う(+ややそう思う)」の回答率は、「子どもに良い影響がある」は26%に対して、「子どもに悪い影響がある」は38%で、心配している教員の方が多いことがわかりました。一方で、「社会に必要だと思う」と考える教員は58%で、「そう思わない(+あまりそう思わない)」は11%でした。そして、「自分も関わりたい」という回答は39%でした。こうした小学校教員の回答からは、学校教育における生成AIの導入は社会に必要だとは考えているものの、子どもへの悪影響を心配している現状を知ることができました。そこで本コラムでは、こうした背景とどのような対処が考えられるかを考えてみたいと思います。

生成AIは、入力された質問に対して回答を生成しますが、これは言葉の意味を理解しているかのように見えます。しかし、実際には、インターネット上の膨大な言語データのつながり(大規模言語モデル)から、確率的に結びつきの強い単語や文のつながりに基づいて、ルールにしたがってなめらかな文章で出力しているものです。ここで、生成AIは出力の文章の内容の真偽のチェックをしていないので、出力が本当に正しいかを吟味する必要があります。

しかし、人は、急いでいるときや、そのことに関して、十分な知識を持っていないときは、自ら考えずに、生成AIの答えをそのままうのみにしてしまい、自ら文章を書かずに、出力をそのまま使うことが起こっています。大学では、こうした形で課題を提出する学生が現れています。こうしたことを繰り返すと、人は、短期的には、誤りを引き起こし、長期的には、思考力や文章の作成能力を低下させてしまうことになる心配があります。

文部科学省のガイドラインでは「生成AIによる生成物をそのまま自己の成果物として応募・提出」することを、適切でない8つの例の一つとして挙げています。そして、生成AIの教育活用によって「思考力を低下させるのではなく、高める使い方をすることが期待される」としています。先の教員調査においては、図1で示すとおり、「生成AIの出力をチェックするなどの批判的思考ができるようになる」に対して、「そう思う(+ややそう思う)」の回答は38%なのに対して、子どもが「自分で考えることが少なくなる」は71%であり、多くの教員がこの問題を心配している実状があります。

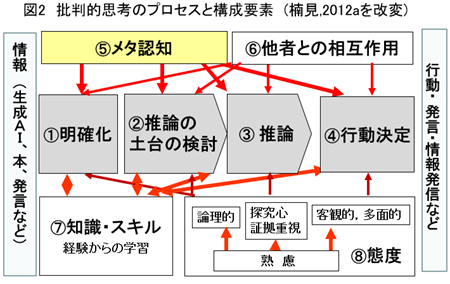

そこで、本コラムでは、人が、思考力を低下させずに、生成AIを活用して、これらの能力を高めるために、批判的思考力の育成が重要であることを述べたいと思います。批判的思考力を高めるためには、批判的に考えるためのスキルを身につける必要があります(楠見,2021a,2021b,2023)。批判的思考は、図2に示すように、4つのステップ:①情報を明確化する、②根拠を検討する、③推論する、④行動決定する――に分かれます。ここでは生成AIを活用する際に、身につけるべき批判的思考スキルの例を挙げます([ ]内は、学習者に身につけてほしいスキルを分かりやすく表現したものです)。

| ① | 情報の明確化[自分で考えてから、よい質問をしよう]:生成AIにプロンプトという質問をして、回答を得ることは、ネット上にある集合知からの情報の検索です。ここでは、明確な問いをおこなうスキルが必要です。人に質問する時も同様ですが、さらに具体的でかつ回答するために必要な情報もあわせて伝えることが大切です。曖昧な質問は、AI(相手)に誤解され、的外れな回答を導きます。思った回答が得られないときは、質問を修正することが必要です。 |

| ② | 情報の土台(根拠)の検討[教えてくれたことが、本当かを調べて考えよう]:人は、生成AIの出力に対して、その情報の信頼性を判断する必要があります。これは生成AIを使わないときも同様ですが、情報の信頼性を判断するスキルが一層必要になります。第1は、情報源の信頼性を判断することです。Being Copilotなどのように、情報源が表示されるものを使い、その情報源が信頼できる質の高いものか、新しいものかを確認することです。第2は自分の知識や経験、他の情報源から得た情報と照らし合わせて、一致するかを判断することです。ここでは、AIの出力が必ずしも正しくない、(ネット上の情報のジェンダーなどの偏りが反映された)バイアスもあるという限界を理解し、自らが知識をもち、他の信頼性の高い情報源を調べるスキルを身につけていることが必要です |

| ③ | 推論[教えてくれたことから、自分の考えをもとう]:②において生成AIの出力から検討した信頼できる複数の情報に基づいて、それらを自分の目的に照らして、その有用性を比較検討したり、倫理的なことも含めた価値判断をするスキルが必要です。これはAIに任せることはできないプロセスです。 |

| ④ | 行動決定[教えたくれたことを、どう使えるかを考えて実行しよう]:③の推論で導いたことを、最後に状況を考慮しつつ、行動の計画を立てて実行するスキル、振りかえって評価するスキルが大切です。 |

これらのプロセスは、つぎの4つの要素に関わるスキルが支えています。

| ⑤ | メタ認知[考えを何度も確認しよう]:メタ認知は、AIの出力を批判的に考えるという①から④の各ステップが、適切に行われているかを意識的に振り返り(モニター)、コントロールする(必要があれば前のステップに戻る)、1段階高いレベルにあるプロセスです。 |

| ⑥ | 他者との相互作用[意見を交換しよう]:AIの出力に基づいて考えたことを、他者との話し合いなどの相互作用によってフィードバックを得ることは、内省を促し、判断に関わる自らのバイアス(偏り)や誤りを修正することにつながります。 |

| ⑦ | 知識・スキル[いろんな経験をして知識を身に付けよう]:①から④のプロセスを的確に進めるには、学校や日常生活におけるさまざまな経験によって身につけた経験やスキルが重要です。AIの出力は、経験に立脚していない言語レベルの答えにすぎませんので、経験に裏付けられた(グラウンディングされた)知識とスキルを活用することが大切です。 |

| ⑧ | 態度[立ち止まって考えよう]:人が現実場面で、生成AIの出力を鵜呑みにしないで、適切な判断をするには、熟慮的な態度をはじめ、論理的・客観的に考え、証拠を重視し、情報を探究しようとする態度を身につけることが大切です。 |

以上の批判的思考の4つのステップと4つの要素に関わるスキルを教えるには次の2つの段階があります。第1の段階では、生成AIを活用する例題を通して、教員は、学習者に明示しながら繰り返し教えて、批判的思考のスキルと態度を身につけることができるようにします。第二の段階では、学習者は、さまざまな問題に主体的に取り組む中で、生成AIの出力に対して批判的思考スキルを適用することを行い、適切にできたかを、他の学習者や教員からフィードバックを受けることで、修正をして、批判的思考スキルを確実に身につけることになります。

本コラムでは、生成AIを活用しつつ、人固有の経験に基づく学びを重視して、批判的思考力を育成することを考えてみました。生成AIは、今後さらに進歩して、社会にそして、教育に大きな影響を及ぼすことが考えられます。そのためにも、人々の思考力を育み、より良い社会を築くためには、どのような教育が必要かを、皆さんとともに考えていきたいと思っています。

参考文献

楠見 孝 (2021a). 批判的思考とメディアリテラシー(前篇)~批判的思考とは何か?:認知心理学の知見から スマートニュース メディア研究所 https://smartnews-smri.com/literacy/literacy-452/

楠見 孝 (2021b). 批判的思考とメディアリテラシー(後篇)~リスク社会における批判的思考とメディアリテラシー スマートニュース メディア研究所 https://smartnews-smri.com/literacy/literacy-437/

楠見 孝 (2023). クリティカルシンキングと社会 菊池 聡(編) より良い思考の技法(仮)放送大学教育振興会

楠見 孝・齊藤貴浩・西川一二・栗山直子(印刷中). 小学校教員における生成AIの教育活用について経験、賛否、期待と意欲:文部科学省の暫定ガイドラインに基づくweb調査による検討 日本教育心理学会第66回総会

文部科学省 (2023). 初等中等教育段階における生成AIの利用に関する暫定的なガイドライン

https://www.mext.go.jp/content/20230718-mtx_syoto02-000031167_011.pdf